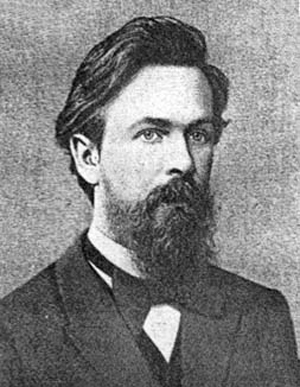

C’est cette observation qui a conduit à la découverte des chaînes de Markov, qui peuvent être considérées comme les précurseurs des processus stochastiques. En étudiant la succession des caractères cyrilliques du roman en vers Eugène Onéguine d’Alexandre Pouchkine, le mathématicien russe Andreï Andreïevitch Markov (1856–1922) remarqua que chaque lettre dépendait, avec une certaine distribution de probabilité, de la lettre qui la précédait immédiatement. Avant de devenir un objet mathématique classique, ce furent ces successions de lettres qui prirent le nom de chaîne de Markov. Dans le monde des maths, les chaînes de Markov s’attachent à décrire un système en évolution pouvant prendre un nombre fini ou dénombrable d’états E1, E 2… Les modifications des états du système sont observées toutes les unités (supposées discrètes) de temps. Markov postule que le passage de l’état E i à l’état E j se fait chaque fois avec une probabilité pi, j . Il décrit un processus sans mémoire : les probabilités de transition dépendent uniquement de l’état du système avant sa transformation (E i ) et de son état après (E j ). De manière générale, on appelle processus markovien un système évoluant de manière aléatoire dans le temps tel que sa distribution de probabilité conditionnelle des états futurs, étant donné la connaissance de ses états passés et son état présent, ne dépend que de ce dernier. Pour de tels processus, la meilleure prévision que l’on puisse faire du futur, à partir de son passé et de son présent, est identique à la meilleure prévision élaborée sur base de la seule connaissance de son état actuel.

C’est cette observation qui a conduit à la découverte des chaînes de Markov, qui peuvent être considérées comme les précurseurs des processus stochastiques. En étudiant la succession des caractères cyrilliques du roman en vers Eugène Onéguine d’Alexandre Pouchkine, le mathématicien russe Andreï Andreïevitch Markov (1856–1922) remarqua que chaque lettre dépendait, avec une certaine distribution de probabilité, de la lettre qui la précédait immédiatement. Avant de devenir un objet mathématique classique, ce furent ces successions de lettres qui prirent le nom de chaîne de Markov. Dans le monde des maths, les chaînes de Markov s’attachent à décrire un système en évolution pouvant prendre un nombre fini ou dénombrable d’états E1, E 2… Les modifications des états du système sont observées toutes les unités (supposées discrètes) de temps. Markov postule que le passage de l’état E i à l’état E j se fait chaque fois avec une probabilité pi, j . Il décrit un processus sans mémoire : les probabilités de transition dépendent uniquement de l’état du système avant sa transformation (E i ) et de son état après (E j ). De manière générale, on appelle processus markovien un système évoluant de manière aléatoire dans le temps tel que sa distribution de probabilité conditionnelle des états futurs, étant donné la connaissance de ses états passés et son état présent, ne dépend que de ce dernier. Pour de tels processus, la meilleure prévision que l’on puisse faire du futur, à partir de son passé et de son présent, est identique à la meilleure prévision élaborée sur base de la seule connaissance de son état actuel.